|

Читайте также: |

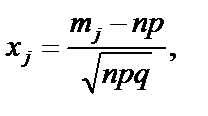

Якщо ймовірність появи випадкової події в кожному з n незалежних експериментів є величиною сталою і дорівнює  , то для великих значень n і m імовірність того, що випадкова подія А настане m раз, подається такою асимптотичною формулою:

, то для великих значень n і m імовірність того, що випадкова подія А настане m раз, подається такою асимптотичною формулою:  ,

,

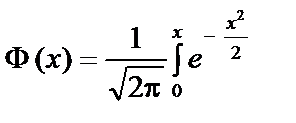

де  ^℮

^℮  називається функцією Гаусса. Функція Гаусса протабульована, де

називається функцією Гаусса. Функція Гаусса протабульована, де  .

.

17. Сформулювати інтегральну теорему Муавра-Лапласа.

Якщо ймовірність появи випадкової події в кожному з n незалежних експериментів є величиною сталою і дорівнює  , то для великих значень n імовірність появи випадкової події від mі до mj раз обчислюється за такою асимптотичною формулою:

, то для великих значень n імовірність появи випадкової події від mі до mj раз обчислюється за такою асимптотичною формулою:  , де

, де

, а

, а  є функцією Лапласа.

є функцією Лапласа.

18. Функція Гаусса та її властивості.

^℮

^℮  називається функцією Гаусса.

називається функцією Гаусса.

Функція Гаусса протабульована, де  .

.

Властивості функції Гаусса:

1)  визначена на всій осі абсцис;

визначена на всій осі абсцис;  ; 2)

; 2)  є функцією парною:

є функцією парною:  ;

;

3)  ; 4)

; 4)  ;

;  ;

;  ;

;  ; отже,

; отже,  — максимум функції Гаусса; 5)

— максимум функції Гаусса; 5)

.

.

Таким чином, х 1 = –1, х 2 = 1 будуть точками перегину. При цьому

;

;  ;

;  .

.

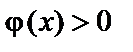

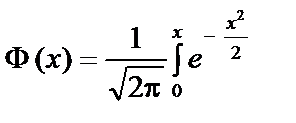

19. Функція Лапласа та її властивості.

є функцією Лапласа

є функцією Лапласа

Властивості функції Лапласа:

1. Ф(x) визначена на всій осі абсцис. 2. Ф(–x) = – Ф(x), отже, Ф(x) є непарною функцією.

3. Ф(0) = 0. 4.  , оскільки

, оскільки  є інтегралом Пуассона.

є інтегралом Пуассона.

5. Ф(–  , як непарна функція. 6.

, як непарна функція. 6.  , отже, Ф(х) є функцією неспадною.

, отже, Ф(х) є функцією неспадною.

7. Ф " (0) = 0;

Таким чином, x = 0 є точкою перегину.

Таким чином, x = 0 є точкою перегину.

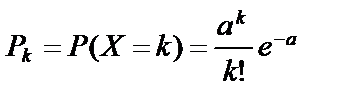

20. Формула Пуассона, умови її використання.

Точність асимптотичних формул для великих значень n — числа повторних незалежних експериментів за схемою Бернуллі — знижується з наближенням p до нуля. Тому при

за умови np = a =const імовірність появи випадкової події m раз

за умови np = a =const імовірність появи випадкової події m раз  обчислюється за такою асимптотичною формулою:

обчислюється за такою асимптотичною формулою:  , яка називається формулою Пуассона.

, яка називається формулою Пуассона.

n велике, а р мале число – використовується для масових малоймовірних випадкових подій.

21. Означення випадкової величини, дискретної та неперервної випадкових величин.

Розглянемо такий простір елементарних подій, в якому кожній елементарній події  Ώ відповідає одне і лише одне число х або набір чисел

Ώ відповідає одне і лише одне число х або набір чисел  , тобто на множині Ώ визначена певна функція

, тобто на множині Ώ визначена певна функція  , яка кожній елементарній події

, яка кожній елементарній події  ставить у відповідність певний елемент одновимірного простору R 1 або n -вимірного простору Rn. Цю функцію називають випадковою величиною.

ставить у відповідність певний елемент одновимірного простору R 1 або n -вимірного простору Rn. Цю функцію називають випадковою величиною.

Отже, величина називається випадковою, якщо внаслідок проведення експерименту під впливом випадкових факторів вона набуває того чи іншого можливого числового значення з певною ймовірністю.

Якщо існує скінчена або злічена множена значень, то таку величину називають дискретною. Якщо кількість можливих значень є нескінченною і задати її за допомогою ряду розподілу неможливо, то величина неперервна.

22. Закон розподілу випадкової величини.

Співвідношення, що встановляє зв’язок між можливими значеннями випадкової величини та відповідними їм імовірностями, називають законом розподілу випадкової величини.

Закон розподілу можна задавати таблицею, формулою, графіком.

У разі табличної форми запису закону подається послідовність можливих значень випадкової величини Х, розміщених у порядку зростання, та відповідних їм імовірностей:

| Х = хі | х1 | х2 | х3 | ...... | хk |

| Р(Х = хі) = рі | р1 | р2 | р3 | ..... | рk |

Оскільки випадкові події (Х = хj) і (Х = хm) є між собою несумісними (Х = хі) ∩ (Х = хm) = Æ, то  - умова нормування для дискретної випадкової величини Х. Закон розподілу таблицею називають рядом розподілу.

- умова нормування для дискретної випадкової величини Х. Закон розподілу таблицею називають рядом розподілу.

23. Інтегральна функція розподілу випадкової величини: означення. Властивості.

Закон розподілу ймовірностей можна подати ще в одній формі, яка придатна і для дискретних, і для неперервних випадкових величин, а саме: як функцію розподілу ймовірностей випадкової величини F (х), так звану інтегральну функцію.

Функцію аргументу х, що визначає ймовірність випадкової події Х < x, називають функцією розподілу ймовірностей: F (x) = P (X < x) - унаслідок експерименту випадкова величина може набути значення, меншого за х.

Розглянемо властивості F (x):

1.

2.  є неспадною функцією, а саме

є неспадною функцією, а саме  , якщо

, якщо  .

.

24. Диференціальна функція розподілу (щільність розподілу) випадкової величини: означення. Властивості.

Для неперервних випадкових величин закон розподілу ймовірностей зручно описувати з допомогою щільності ймовірностей, яку позначають f (x).

Щільністю ймовірностей неперервної випадкової величини Х називається перша похідна від інтегральної функції F(x):

звідки

звідки

Оскільки  то добуток f (x) dx — ймовірність того, що випадкова величина Х міститиметься у проміжку [х, х + dx], де

то добуток f (x) dx — ймовірність того, що випадкова величина Х міститиметься у проміжку [х, х + dx], де  .

.

Геометрично на графіку щільності ймовірності f (x) dx відповідає площа прямокутника з основою dx і висотою f (x).

Властивості f (x)

1.  . Ця властивість випливає з означення щільності ймовірності як першої похідної від F(x) за умови, що F(x) є неспадною функцією.

. Ця властивість випливає з означення щільності ймовірності як першої похідної від F(x) за умови, що F(x) є неспадною функцією.

2. Умова нормування неперервної випадкової величини Х:

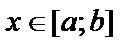

Якщо НВВ Х належить [a; b], то умовою нормування буде

3. Імовірність попадання неперервної випадкової величини в інтервалі  обчислюється за формулою

обчислюється за формулою

4. Функція розподілу ймовірностей неперервної випадкової величини має вигляд

25. Математичне сподівання випадкової величини: означення, властивості.

Однією з найчастіше застосовуваних на практиці характеристик є математичне сподівання.

Термін «математичне сподівання» випадкової величини Х є синонімом терміна «середнє значення» випадкової величини X.

Математичним сподіванням випадкової величини Х, визначеною на дискретному просторі Ω, називається величина

Якщо Ω — обмежена множина, то  .

.

Якщо простір Ω є неперервним, то математичним сподіванням неперервної випадкової величини Х називається величина

Якщо Ω = (– ¥; ¥), то

Якщо Ω = [ a; b ], то

Властивості математичного сподівання

1. Математичне сподівання від сталої величини С дорівнює самій сталій: М (С) = С.

2. М (СХ) = СМ (Х).

Для дискретної випадкової величини згідно із маємо  .

.

Для неперервної:

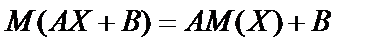

3. Якщо А і В є сталими величинами, то  .

.

Для дискретної випадкової величини:  .

.

Для неперервної випадкової величини:

26. Дисперсія та середньоквадратичне відхилення випадкової величини: означення, властивості.

Математичне сподівання не дає достатньо повної інформації про випадкову величину, оскільки одному й тому самому значенню М (Х) може відповідати безліч випадкових величин, які будуть різнитися не лише можливими значеннями, а й характером розподілу і самою природою можливих значень.

В разі рівності математичних сподівань (М (X) = М (Y) = 0) випадкові величини Х і Y мають тенденцію до коливань відносно М (X) та М (Y), причому Y має більший розмах розсіювання відносно М (Y), ніж випадкова величина Х відносно М (Х). Тому математичне сподівання називають центром розсіювання. Для вимірювання розсіювання вводиться числова характеристика, яку називають дисперсією. Дисперсією випадкової величини Х називається математичне сподівання квадрата відхилення цієї величини  . Для дискретної випадкової величини Х дисперсія

. Для дискретної випадкової величини Х дисперсія  ;для неперервної

;для неперервної  . Якщо Х Î [а; b], то

. Якщо Х Î [а; b], то  .

.

Властивості дисперсії

1. Якщо С — стала величина, то D(C)=0.

2.  .

.

3. Якщо А і В — сталі величини, то  .

.

Дисперсію можна обчислити і за такою формулою:

Дисперсія не може бути від’ємною величиною  .

.

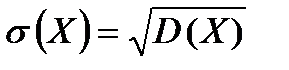

Середнім квадратичним відхиленням випадкової величини Х називають корінь квадратний із дисперсії:  .

.

27. Мода, медіана випадкової величини.

Модою (Мo) дискретної випадкової величини Х називають те її можливе значення, якому відповідає найбільша ймовірність появи. Модою для неперервної випадкової величини Х називають те її можливе значення, якому відповідає максимальне значення щільності ймовірності: f (Mо) = max.

Якщо випадкова величина має одну моду, то такий розподіл імовірностей називають одномодальним; якщо розподіл має дві моди — двомодальним і т. ін. Існують і такі розподіли, які не мають моди. Їх називають антимодальними.

Медіаною (Ме) неперервної випадкової величини Х називають те її значення, для якого виконуються рівність імовірностей подій:

28. Початкові та центральні моменти.

Узагальненими числовими характеристиками випадкових величин є початкові та центральні моменти.

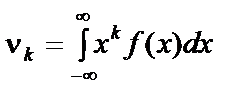

Початковим моментом k -го порядку випадкової величини Х називають математичне сподівання величини Х k:  .

.

Коли  коли k = 2,

коли k = 2,  і т. д.

і т. д.

Для дискретної випадкової величини Х  ;

;

для неперервної  .

.

Якщо Х Î [ а; b ], то  .

.

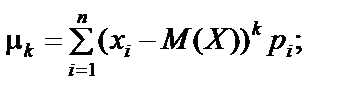

Центральним моментом k -го порядку називається математичне сподівання від (Х – М (Х)) k:

Коли  коли k = 2,

коли k = 2,  ; коли k = 3,

; коли k = 3,  коли k = 4,

коли k = 4,  .

.

Для дискретної випадкової величини

для неперервної

Якщо Х Î [ а; b ], то  .

.

29. Асиметрія, ексцес.

Третій центральний момент характеризує асиметрію закону розподілу випадкової величини. Якщо m3 = 0, то випадкова величина Х симетрично розподілена відносно М (Х). Оскільки m3 має розмірність випадкової величини в кубі, то вводять безрозмірну величину — коефіцієнт асиметрії:  .

.

Центральний момент четвертого порядку використовується для визначення ексцесу, що характеризує плосковершинність, або гостровершинність щільності ймовірності f (x). Ексцес обчислюється за формулою

Зауважимо, що число 3 віднімається ось чому. Для центрального закону розподілу, так званого нормального закону, виконується рівність:

Отже, Еs = 0.

Отже, Еs = 0.

30. Означення багатовимірної випадкової величини.

Одночасна поява внаслідок проведення експерименту n випадкових величин (X 1, X 2, …, Xn) з певною ймовірністю являє собою n -вимірну випадкову величину, яку називають також системою n випадкових величин.

31. Означення закону розподілу багатовимірної випадкової величини.

Законом розподілу двох дискретних випадкових величин називають перелік можливих значень Y = yi , X = xj та відповідних їм імовірностей спільної появи.

У табличній формі цей закон має такий вигляд:

| X = xj Y = yi | x 1 | x 2 | x 3 | … | xm | pyi |

| y 1 | p 11 | p 12 | p 13 | p 1 m | p y1 | |

| y 2 | p 21 | p 22 | p 23 | p 2 m | p y2 | |

| y 3 | p 31 | p 32 | p 33 | p 3 m | p y3 | |

| … | … | … | … | … | … | … |

| yk | pk 1 | pk 2 | pk 3 | … | pkm | pym |

| pxj | px 1 | px 2 | px 3 | … | pxm |

Тут використано такі позначення  Умова нормування має такий вигляд:

Умова нормування має такий вигляд:

32. Основні числові характеристики для системи двох дискретних випадкових величин.

33. Коефіцієнт кореляції та його властивості.

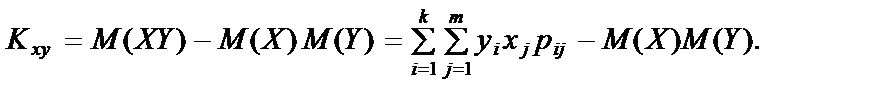

Під час вивчення системи двох і більше випадкових величин доводиться з’ясовувати наявність зв’язку між цими величинами та його характер. З відповідною метою застосовують так званий кореляційний момент:

У разі Κху = 0 зв’язок між величинами Х та Y, що належать системі (Х, Y), відсутній. Коли Κху ¹ 0, то між відповідними Х і Y кореляційний зв’язок існує.

Тісноту кореляційного зв’язку характеризує коефіцієнт кореляції:

, або

, або  .

.

Отже, якщо випадкові величини Х та Y є незалежними, то Κ ху = 0 і rху = 0. Рівність нулеві rху є необхідною, але не достатньою умовою незалежності випадкових величин.

Дві випадкові величини Х і Y називають некорельованими, якщо rху = 0, і корельованими, якщо rху ¹ 0.

34. Функція розподілу ймовірностей та щільність ймовірностей системи

35. Двовимірний нормальний закон розподілу.

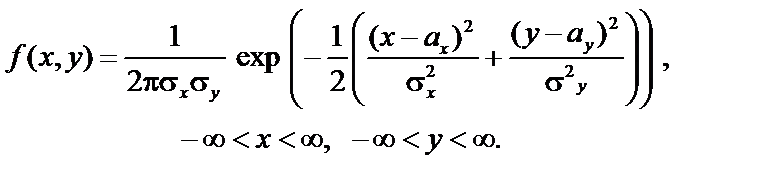

Щільність імовірностей для нормального закону на площині має вигляд

.

.

Тут exp (z) = e – z , де  ;

;

ax = M (Х),

Якщо rxy = 0, то щільність імовірностей набере такого вигляду:

У цьому випадку

Якщо ах = ау = 0, то

У результаті перетину поверхні площинами, паралельними координатній площині хОу, і проектування перерізів на цю площину утворюється множина подібних і однаково розташованих еліпсів зі спільним центром на початку координат. Кожний такий еліпс — геометричне місце точок, де f (x, y) є величиною сталою. Тому еліпси називають еліпсами рівних щільностей. Перетинаючи поверхні такими площинами і проектуючи ці перерізи на координатну площину хОу, дістаємо множину кіл.

Імовірність потрапляння (Х, Y) у прямокутну область а < x < b, c < y < d, коли Kxy = 0:

.

.

36. Закон розподілу Бернулі

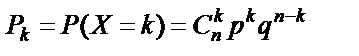

37. Біноміальний закон розподілу ДВВ. числові характеристики.

Цілочислова випадкова величина X має біноміальний закон розподілу, якщо ймовірність її можливих значень обчислюється за формулою Бернуллі:  k = 0, 1, 2, 3,..., n.

k = 0, 1, 2, 3,..., n.

У табличній формі цей закон набирає такого вигляду:

| ... | n | ||||

|

|

|

|

|

|

При перевірці виконання умови нормування використовується формула біному Ньютона, тому закон розподілу називають біноміальним:  .

.

Основні числові характеристики для цього закону:  ,

,  ,

,  .

.

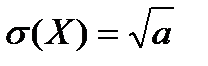

38. Пуасонівський закон розподілу ДВВ, числові характеристики.

Цілочислова випадкова величина Х має пуассонівський закон розподілу, якщо ймовірності її можливих значень  , k = 0, 1, 2,3,..., n, тобто обчислюється за формулою Пуассона, де a=np. У табличній формі цей закон розподілу буде такий:

, k = 0, 1, 2,3,..., n, тобто обчислюється за формулою Пуассона, де a=np. У табличній формі цей закон розподілу буде такий:

| Х = k | … | n | ||||||

|

|

|

|

|

| |||

.

.

.

.

;

;

.

.

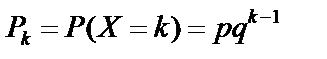

39. Геометричний закон розподілу ДВВ, числові характеристики.

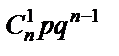

Інколи спроби здійснюють до першої появи випадкової події. Число проведених спроб буде цілочисловою випадковою величиною. Цілочислова випадкова величина Х має геометричний закон розподілу, якщо ймовірності її можливих значень  , k = 1, 2, 3, …, n.

, k = 1, 2, 3, …, n.

p — імовірність появи випадкової події в кожній спробі — є величиною сталою, q = 1 – p.

У табличній формі геометричний закон розподілу такий:

| ... | ||||

|

|

|

|

| ... |

При перевірці умови нормування використовується формула суми нескінченної геометричної прогресії, тому й закон розподілу називають геометричним:

Числові характеристики для цього закону:

,

,  ,

,  .

.

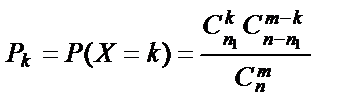

40. Гіпергеометричний закон розподілу ДВВ, числові характеристики.

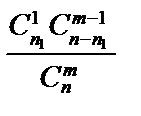

Цілочислова випадкова величина Х має гіпергеометричний закон розподілу, якщо ймовірність її можливих значень обчислюється за формулою  .

.

Гіпергеометричний закон розподілу ймовірностей відбувається за таких обставин: нехай задано деяку множину однотипних елементів, число яких дорівнює n; з них  елементів мають, наприклад, ознаку А (колір, стандартність), а решта

елементів мають, наприклад, ознаку А (колір, стандартність), а решта  елементів — ознаку В; коли із цієї множини навмання беруть m елементів, число елементів k з ознакою А (або В), що трапляється серед m навмання взятих елементів, буде цілочисловою випадковою величиною з гіпергеометричним законом розподілу.

елементів — ознаку В; коли із цієї множини навмання беруть m елементів, число елементів k з ознакою А (або В), що трапляється серед m навмання взятих елементів, буде цілочисловою випадковою величиною з гіпергеометричним законом розподілу.

У табличній формі запису цей закон розподілу подається так:

| ... | m | |||

|

|

|

|

|

Умова нормування  .

.

Залежно від умови задачі найменше значення може становити m = 0, 1, 2, 3,..., m – 1. Числові характеристики цього закону обчислюються за наведеними далі формулами:  ,

,  ,

,

41. Рівномірний закон розподілу НВВ.

Неперервна випадкова величина Х, що визначена на проміжку [ a, b ], має рівномірний закон розподілу, якщо

Функція розподілу ймовірностей

Ймовірність належності будь-якому проміжку, що належить [a, b] пропорційно довжині цього проміжку.

P(x1<X<x2) =

=

=

42. Нормальний закон розподілу.

Випадкова величина Х має нормальний закон розподілу ймовірностей, якщо

f (х) =  , –

, –  < x <

< x <  , де а = М (X), s = s (X).

, де а = М (X), s = s (X).

F (x) =  dx.

dx.

Якщо а = 0 і s = 1, f (x) =  –

–  < x <

< x <  , F (x) =

, F (x) =  dx.

dx.

Графіки f (x), F (x) для загального нормального закону

= а

= а

= s2

= s2

= s.

= s.

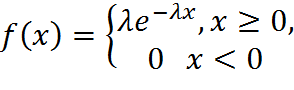

43. Показниковий закон та його використання в теорії надійності та теорії черг.

Закон розподілу ймовірностей неперервної ВВ Х називається показниковим з параметром  , якщо його щільність розподілу рівна:

, якщо його щільність розподілу рівна:

Функція розподілу

Математичне сподівання – M(x) =

Дисперсія – D(x) =

Ймовірність належності ВВ Х, розподіленої за показниковим законом, будь-якому інтервалу (a,b):

P(a<X<b)=

Показниковий розподіл широко застосовується в теорії надійності технічного обладнання для характеристики терміну безвідмовної роботи елементів та пристроїв і в теорії масового обслуговування для характеристики тривалості обслуговування.

Якщо ВВ  - тривалість безвідмовної роботи деякого елемента, то ймовірність відмови елемента за час t рівна

- тривалість безвідмовної роботи деякого елемента, то ймовірність відмови елемента за час t рівна  , а ймовірність безвідмовної роботи за час t рівна

, а ймовірність безвідмовної роботи за час t рівна

. При цьому параметр

. При цьому параметр  - є інтенсивністю відмов цього елемента.

- є інтенсивністю відмов цього елемента.

Більша частина величин і часових оцінок на практиці підлягають більшому або меншому розсіюванню. Тому черги є неминучим лихом нашої епохи. Але якщо очікування є неминучим, його можна в деякій мірі контролювати: систему чи організацію, на вході якої утворюється черга, можна перетворити і покращити з тим, щоб внаслідок черг нести мінімальні втрати.

Дослідженням черг займається спеціальна наука - теорія черг, або теорія масового обслуговування. Зараз ця теорія стала необхідною частиною дослідження операцій і пошуку оптимальних техніко-економічних рішень в промисловості, на транспорті, в економіці, торгівлі і ряді інших галузей народного господарства. Багаточисленні запитання надійності складних систем базуються в основному на результатах теорії масового обслуговування.

Теорія масового обслуговування - відносно нова галузь, яка базується на працях російського математика Маркова, що дослідив так названі марковські процеси. Одним з основних понять теорії масового обслуговування є поняття про вхідний потік вимог (заявок) на обслуговування.

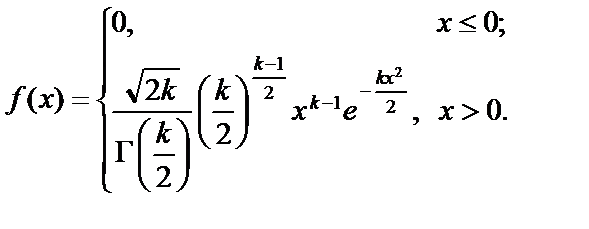

44. Розподіл

45.Розподіл Стьюдента. Розподіл Фішера. (45-46)

Незалежні випадкові величини Y і Х мають закони розподілу:

Знайти f (z), якщо  . Для зручності подальших перетворень запишемо f (x) у вигляді

. Для зручності подальших перетворень запишемо f (x) у вигляді

Отже, якщо Y має розподіл N (0, 1), а випадкова величина

Х –  , то випадкова величина

, то випадкова величина  характеризуватиметься розподілом Стьюдента зі щільністю ймовірностей

характеризуватиметься розподілом Стьюдента зі щільністю ймовірностей

Тоді функція розподілу ймовірностей

46. Див 45

47. Правило трьох сигм. Логарифмічний нормальний закон.

Якщо ВВХ розподіляється нормально, то ймовірність  →0, тобто практично достовірною є подія, що ВВХ відхилена від свого середнього значення а (М(х)) не більше, ніж на потроєне середнє квадратичне відхилення

→0, тобто практично достовірною є подія, що ВВХ відхилена від свого середнього значення а (М(х)) не більше, ніж на потроєне середнє квадратичне відхилення  . Якщо закон розподіл ВВХ невідомий, але

. Якщо закон розподіл ВВХ невідомий, але  , то закон розподілу є нормальний.

, то закон розподілу є нормальний.

Нехай Y має закон розподілу

Закон розподілу випадкової величини Х із щільністю називають логарифмічним нормальним законом.

48.Функції одного дискретного випадкового аргументу.

Функцією випадкового аргументу Х називають таку випадкову величину Y, яка набуває значення Y = у =  (х) щоразу, коли Х = х, де

(х) щоразу, коли Х = х, де  є невипадковою функцією. Якщо Х є дискретною випадковою величиною, то і функція випадкового аргументу Y =

є невипадковою функцією. Якщо Х є дискретною випадковою величиною, то і функція випадкового аргументу Y =  (х) буде дискретною.

(х) буде дискретною.

Коли Х є неперервною випадковою величиною, то і Y =  (х) буде неперервною.

(х) буде неперервною.

1.1. Функції дискретного випадкового аргументу

Нехай закон дискретної випадкової величини Х задано таблицею:

| Х = хi | x1 | x2 | x3 | ............ | xk |

| P (X = xi)= pi | p 1 | p 2 | p 3 | ............. | pk |

Тоді закон розподілу випадкової величини Y =  (х) матиме такий вигляд:

(х) матиме такий вигляд:

| Y = α (хi) | α (х 1) | α (х 2) | α (х 3) | .................. | α (хk) |

| P (Y = α (хi) = рi | p 1 | p 2 | p 3 | ............... | pk |

де кожне можливе значення Y дістають, виконуючи ті операції, які вказані в невипадковій функції, умовно позначеній α.

При цьому, якщо в законі розподілу випадкової величини Y є повторення значень, то кожне з цих значень записують один раз, додаючи їх імовірності.

Приклад 1.

Закон розподілу дискретної випадкової величини Х задано таблицею:

| Х = хi | – 4 | –2 | –1 | |||

| Р (X = хi) = рi | 0,1 | 0,2 | 0,1 | 0,1 | 0,2 | 0,3 |

Побудувати закон розподілу ймовірностей для Y = 3 х 2.

Розв’язання. Iз функціональної залежності Y = 3 х 2 маємо:

| Y = 3 хi 2 | ||||||

| Р (у = 3 хi 2) = рi | 0,1 | 0,2 | 0,1 | 0,1 | 0,2 | 0,3 |

Ураховуючи повтори можливих значень Y, дістаємо:

Р (у = 16) = 0,1 + 0,3 = 0,4;

Р (у = 4) = 0,2 + 0,2 = 0,4;

Р (у = 1) = 0,1 + 0,1 = 0,2.

Отже, закон розподілу дискретної випадкової величини Y набирає такого вигляду:

| Y = уj | |||

| Р (у = уj) = рj | 0,2 | 0,4 | 0,4 |

49..Числові характеристики функції одного дискретного випадкового аргументу.

1. Математичне сподівання

2. Дисперсія

3. Середнє квадратичне відхилення

Приклад 2. За заданим законом розподілу

| Х = хi |

|

|

|

|

|

| |

| Р (Х = хi) = pi | 0,1 | 0,2 | 0,1 | 0,1 | 0,2 | 0,1 | 0,2 |

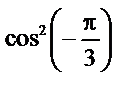

Обчислити  М (Y), D (Y), s (Y), якщо Y = cos2 х.

М (Y), D (Y), s (Y), якщо Y = cos2 х.

Розв’язання. Побудуємо закон розподілу Y.

| Y = cos2 хi |

|

|

|

|

|

|

|

| Р (Y = cos2 хi) = pi | 0,1 | 0,2 | 0,1 | 0,1 | 0,2 | 0,1 | 0,2 |

або

| Y = cos2 хi |

|

|

|

|

|

| |

| Р (Y = cos2 хi) = pi | 0,1 | 0,2 | 0,1 | 0,1 | 0,2 | 0,1 | 0,2 |

| Y = cos2 хi |

|

|

|

|

|

| |

| Р (Y = cos2 хi) = pi | 0,1 | 0,2 | 0,1 | 0,1 | 0,2 | 0,1 | 0,2 |

| Y = уj | 0,25 | 0,5 | 0,75 | |

| Р (Y = уj) = pj | 0,3 | 0,3 | 0,3 | 0,1 |

50. Функції неперервного випадкового аргументу та їх числові характеристики.

Нехай закон розподілу ймовірностей неперервної випадкової величини Х задано щільністю f (х).

Необхідно знайти f (у), якщо Y =  .

.

А. Функція  монотонна.

монотонна.

Розглянемо випадок, коли Y =  є монотонно зростаючою функцією, зображеною на мал. 1.

є монотонно зростаючою функцією, зображеною на мал. 1.

Мал. 1

Якщо випадкова величина Х міститься у проміжку [х; х + Dх], то оскільки Y жорстко зв’язана з випадковою величиною Х функцією  (х), то Y міститиметься у проміжку [у, у + Dу] (мал.1). Отже, події х < Х < х +Dх і у < Y < у +Dу будуть рівноймовірними:

(х), то Y міститиметься у проміжку [у, у + Dу] (мал.1). Отже, події х < Х < х +Dх і у < Y < у +Dу будуть рівноймовірними:

Р(х < Х < х +Dх) = Р(у < Y < у +Dу). (1)

Згідно з визначенням щільності ймовірностей

.

.

Але F(у +  у) – F(у) = Р (у < Y < у +Dу) = Р (х < Х < х +Dх) згідно зі (1).

у) – F(у) = Р (у < Y < у +Dу) = Р (х < Х < х +Dх) згідно зі (1).

Тоді:

Отже,

. (2)

. (2)

При Dу  0, Dх

0, Dх  0 з урахуванням функціональної залежності між Y і Х, помноживши і поділивши дріб (2) на Dх, дістанемо:

0 з урахуванням функціональної залежності між Y і Х, помноживши і поділивши дріб (2) на Dх, дістанемо:

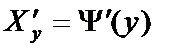

Із Y = a(х) знаходимо явно Х =  (у). Тоді

(у). Тоді

(3)

(3)

Якщо  , де

, де  є монотонно спадною функцією (мал..2),

є монотонно спадною функцією (мал..2),

мал. 2

то додатному приросту аргументу х +Dх відповідатиме від’ємний приріст функції y – Dy i похідна  .

.

А оскільки f (y)  0, то об’єднуючи обидва випадки, дістанемо

0, то об’єднуючи обидва випадки, дістанемо

(4)

(4)

Б. Загальна методика знаходження f (у).

Нехай неперервна випадкова величина Х задана щільністю ймовірностей f (х), якщо  .

.

Необхідно визначити f (у), якщо  , де

, де  є монотонною функцією.

є монотонною функцією.

1. Необхідно визначити множину можливих значень для Y

Оскільки  то

то  .

.

2. Із  знаходимо явний вираз Х через Y, а саме:

знаходимо явний вираз Х через Y, а саме:  .

.

3. Знаходимо похідну  .

.

4. Будуємо щільність імовірностей для випадковой величини Y

.

.

5. Перевіряється виконання умови нормування для f (у):

.

.

Якщо нормування виконується, то f (у) знайдено вірно.

За знайденою f (у) функцією розподілу ймовірностей визначається

.Числові характеристики функцій неперервного випадкового аргументу визначаються за формулами:

.Числові характеристики функцій неперервного випадкового аргументу визначаються за формулами:

математичне сподівання

;

;

дисперсія

;

;

середнє квадратичне відхилення  .

.

51. Функції двох випадкових аргументів та їх числові характеристики.

У загальному випадку функцію двох аргументів Х і Y можна позначити як  , де

, де  є невипадковою функцією.

є невипадковою функцією.

Якщо Х та Y є дискретними випадковими величинами, то і Z буде дискретною. Якщо Х та Y є неперервними, то і Z буде неперервною.

Розглянемо функціональну залежність Z = Х + Y, де Х і Y є неперервними випадковими величинами.

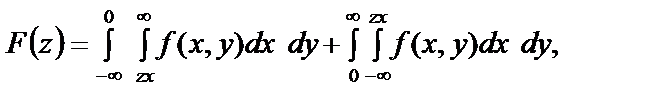

Потрібно за відомою щільністю f (x, y) знайти F (z), f (z).

Імовірність влучення Z в області Z < z, а саме Z < Х + Y.

Ця ймовірність обчислюється так:

або

або

Тоді щільність імовірностей для випадкової величини Z буде така:

52. Знаходження F (z), f (z), якщо Z = Х + Y

Розглянемо функціональну залежність Z = Х + Y, де Х і Y є неперервними випадковими величинами.

Потрібно за відомою щільністю f (x, y) знайти F (z), f (z).

Імовірність влучення Z в області Z < z, а саме Z < Х + Y зображено на мал.

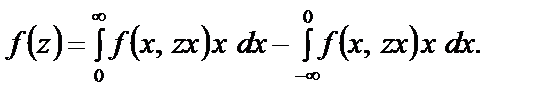

Ця ймовірність обчислюється так:

або

Оскільки

то попередні формули можна подати так:

то попередні формули можна подати так:

Тоді щільність імовірностей для випадкової величини Z буде така:

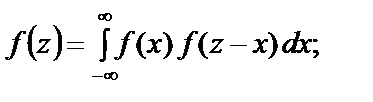

Отже,

Якщо випадкові величини Х і Y є незалежними, то f (x, y) =

= f (x) f (y). За цієї умови формули наберуть такого вигляду:  (1)

(1)  (2)

(2)

Формули (1), (2) називають згорткою, або композицією, двох законів.

53. Знаходження F(Z), f (z), якщо Z = Х/Y.(Y=ZX)

Оскільки пряма Y = ZХ ділить площину хОу на дві непересічені області, зображені на рис. 82.

Рис. 82

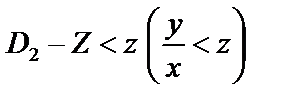

В області D1 виконується випадкова подія  і в області

і в області  . Отже, імовірність події

. Отже, імовірність події  дорівнюватиме сумі ймовірностей двох несумісних випадкових подій, що зможуть відбутися або в області

дорівнюватиме сумі ймовірностей двох несумісних випадкових подій, що зможуть відбутися або в області  , або в області

, або в області  :

:

.

.

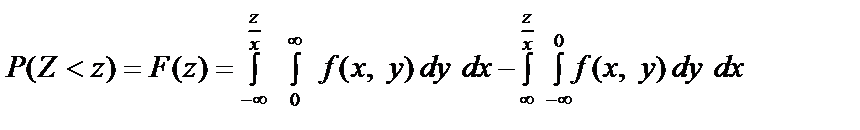

Отже,

(211)

(211)

або

(212)

(212)

Щільність імовірностей

Остаточно маємо:

(213)

(213)

Якщо Х і Y є незалежними, то

. (214)

. (214)

54. Знаходження F(Z), f (z), якщо Z = ХY.

Якщо Z =ХY, тобто випадкова величина Z дорівнює добутку двох випадкових величин Х і Y, то ймовірність потрапляння випадкової величини Z в область

унаочнює рис. 83.

унаочнює рис. 83.  Рис. 83

Рис. 83

Маємо:

або  . (215)

. (215)

Скориставшись (215), дістанемо

Отже,  (216)

(216)

Якщо випадкові величини Х і Y є незалежними, то

. (217)

. (217)

55. Числові характеристики функції дискретного випадкового аргументу

1. Математичне сподівання

Дата добавления: 2015-10-31; просмотров: 255 | Нарушение авторских прав

| <== предыдущая страница | | | следующая страница ==> |

| СЛОВНИК ОСНОВНИХ ПОНЯТЬ ТА ТЕРМІНІВ | | | Теорема Чебишева. |