Читайте также:

|

Для случая, когда символы алфавита встречаются с равными

вероятностями:

I = k  = 14

= 14  log214=14

log214=14  3,80735 = 53,3029

3,80735 = 53,3029  54 бит;

54 бит;

Для случая, когда символы алфавита встречаются в сообщении с

заданными вероятностями:

Вычисление неопределённости (энтропии), приходящейся на символ алфавита для неравновероятностных алфавитов:

H =

=2,44827

=2,44827  3бит/символ

3бит/символ

Вычисление неопределённости (энтропии), приходящейся на символ первичного (кодируемого) алфавита, составленного из равновероятностных и взаимонезависимых символов:

Hmax= log2 k = 3,80735бит»4 бит.

Вычисление количества информации для случая, когда символы

алфавита встречаются в сообщении с заданными вероятностями:

I =

Вычисление абсолютнойнедогруженности символов:

D = (Hmax  H)= 3,80735

H)= 3,80735  2,44827=1,35908

2,44827=1,35908  2бит/символ

2бит/символ

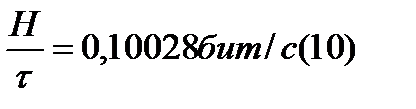

4.2.2 Вычисление теоретической скорости передачи сообщений

4.2.2 Вычисление теоретической скорости передачи сообщений

C =

Дата добавления: 2015-08-10; просмотров: 63 | Нарушение авторских прав

| <== предыдущая страница | | | следующая страница ==> |

| Практическая часть | | | Построение оптимального кода сообщения |